[2019 CVPR] Edge-Labeling Graph Neural Network for Few-shot Learning

Table of content (short-version) [paper] [github]

Summary

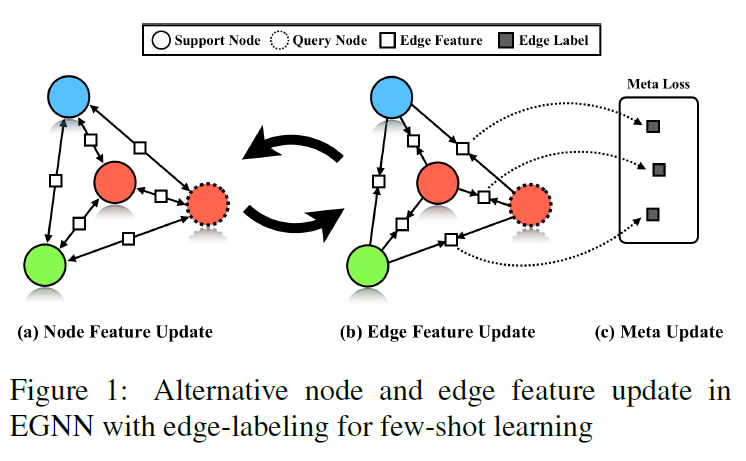

- Edge-labeling GNN (EGNN) 제안

- GNN은 node에 대한 feature 계산, A 행렬을 통해 node 연관 관계 고려

- EGNN은 edge에도 feature vector를 넣는 방식

- Node와 edge 번갈아 가면서 계산

- Few-shot learning 논문

- Meta learning의 일종으로 학습하기위한 영상이 적을 때를 말함

- N-way K-shot learning 등으로 표현 (N: label, K: labeled sample)

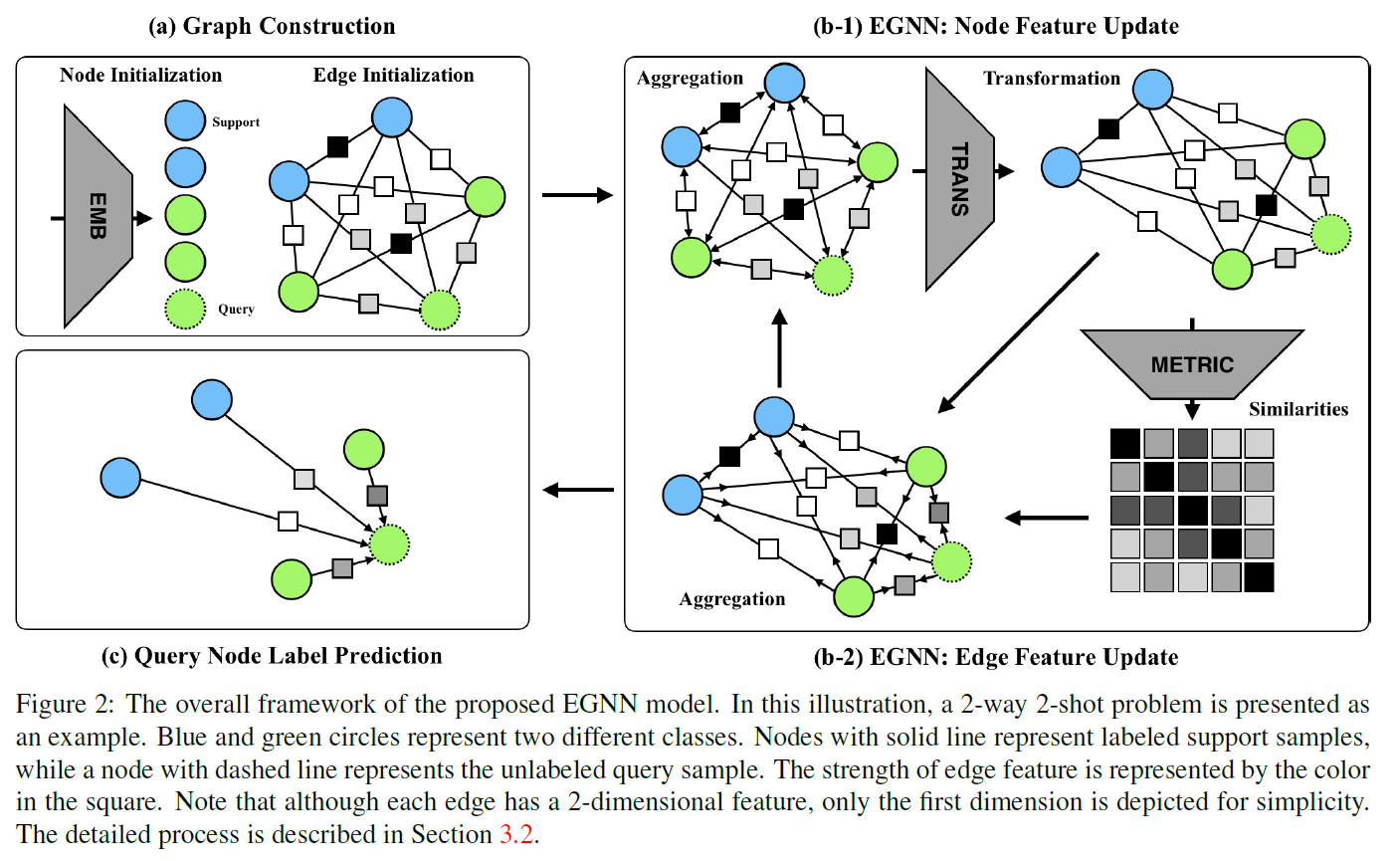

- Edge labeing은 노드의 label 같으면 1 아니면 0

- Edge의 feature는 2-dim vector

- 첫번째 dim은 intra class sim

- 두번째 dim은 inter class dissim

- dissimilarity까지 고려했더니 쿼리에서 거리가 좀 떨어짐 (이전에는 query끼리 너무 뭉쳐있었다)

- 최초 초기화

- [1,0] : 트레이닝 셋 내에서 엣지 label이 1일 때

- [0,1] : 트레이닝 셋 내에서 label이 0일 때

- [0.5, 0.5] : 나머지 (query 포함)

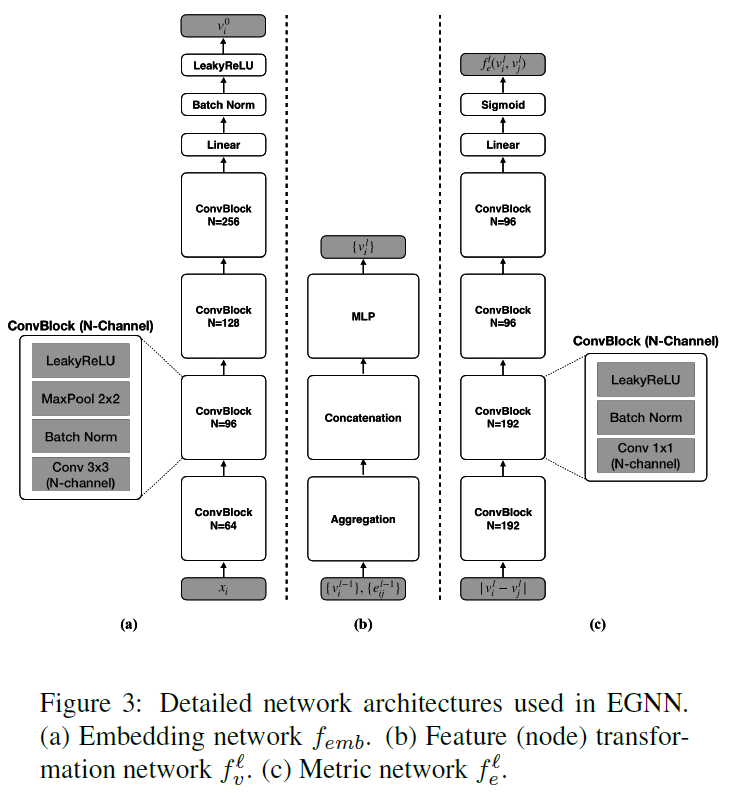

- Node feature는 cnn feature를 사용

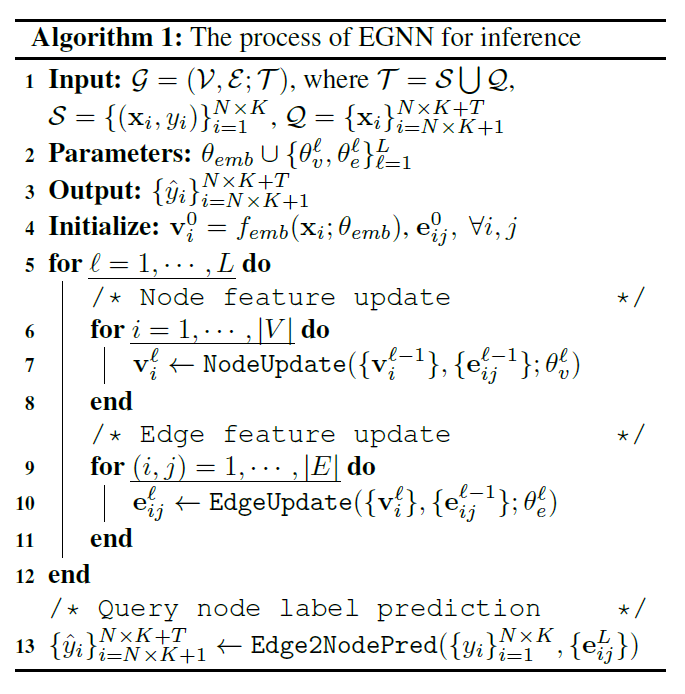

- 총 L번의 iteration (inference)

- V, E를 번갈아가면서 업데이트

- 노드의 prediction은 각 노드마다 연결된 엣지의 특징을 보면서 weighted voting 수행

- 쿼리 샘플을 한번에 처리할 수 있다는 장점

- 학습 방식은 episodic training (meta learning)

[개요]

[전체 프레임워크]

[디테일 아키텍처]

[전체 알고리즘]

References

[1] Kim, Jongmin, et al. “Edge-Labeling Graph Neural Network for Few-shot Learning.” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2019.